- Platforma badawcza

Źródła informacji

Analiza danych

Działania

- Rozwiązania

Dla kogo

Zagadnienia

- Materiały

Materiały

- O nas

O nas

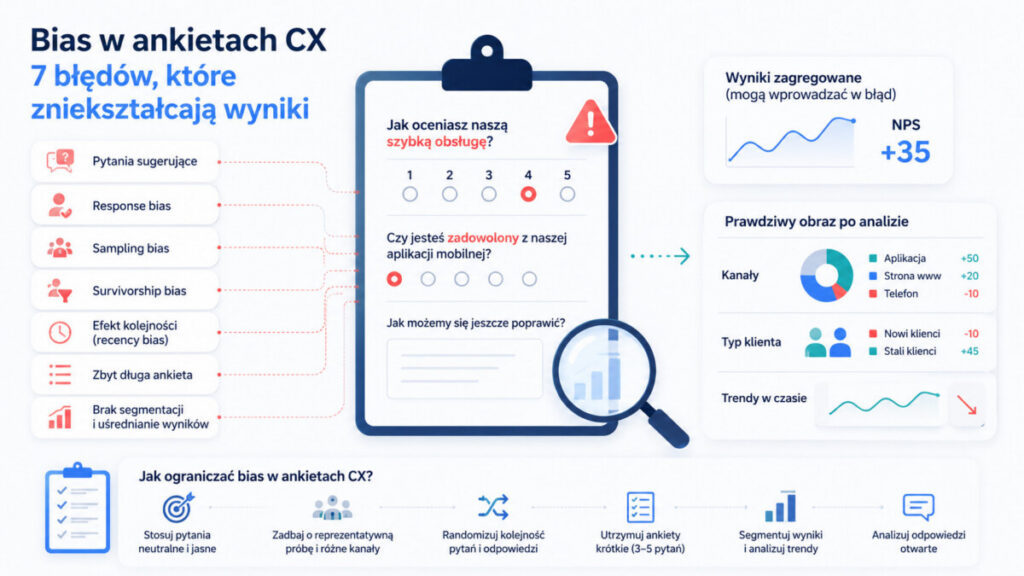

Nawet profesjonalne badania CX są podatne na bias, który może prowadzić do błędnych wniosków i nieprawidłowych decyzji biznesowych. Różnice rzędu 5-10 punktów NPS często wynikają nie z realnych zmian w doświadczeniu klienta, lecz z niekontrolowanych błędów metodologicznych.

Co musisz wiedzieć:

Nowoczesne platformy CX automatycznie wychwytują 40-60% błędów, takich jak zbyt długie ankiety czy brak równowagi w próbie.

W wielu organizacjach NPS, CSAT i CES są traktowane jako “twarde” liczby, niemal na poziomie danych finansowych. Według raportu Gartnera 2025, 78% firm Fortune 500 używa NPS jako KPI dla CEO. W Polsce 65% firm z sektora usług opiera decyzje o inwestycjach w CX na ankietach, z budżetami VoC przekraczającymi 500 tys. PLN rocznie.

Problem polega na tym, że liczby z dashboardów są postrzegane jako obiektywne, choć w tle kryją się decyzje badawcze: konstrukcja ankiety, dobór próby, sposób dystrybucji, analiza danych.

Przykład: Firma e-commerce zmienia mail z zaproszeniem do NPS z “proszę ocenić” na “podziel się opinią”. Widzi wzrost NPS o +7 p.p. i świętuje sukces. Tymczasem 40% nowych odpowiedzi pochodzi od lojalnych klientów – to klasyczny sampling bias, który maskuje spadek satysfakcji wśród nowych użytkowników.

W dalszej części artykułu wyjaśniam, czym jest bias w ankietach CX i które 7 najczęstszych błędów zniekształcają wyniki badań ankietowych.

Bias to systematyczny błąd w badaniach ankietowych, który sprawia, że wyniki NPS, CSAT czy CES odbiegają od rzeczywistego doświadczenia klienta. W przeciwieństwie do losowego “szumu” (przypadkowych wahań), bias kierunkowo przesuwa wyniki – na przykład systematycznie zawyża NPS o 5-15 punktów.

Główne źródła biasu w badaniach CX:

| Kategoria | Przykłady |

|---|---|

| Konstrukcja ankiety | Leading questions, błędne skale |

| Dobór próby | Sampling bias, survivorship bias |

| Zachowania respondentów | Social desirability, acquiescence bias |

| Decyzje analityczne | Confirmation bias, analiza tylko średnich |

Błędy w projektowaniu ankiet prowadzą do zniekształcenia wyników i podejmowania błędnych decyzji biznesowych – nawet dobrze zaprojektowana ankieta może okazać się niewystarczająca, jeśli cele badania są niejasne lub pytania źle dopasowane do kontekstu. Według Deloitte CX Trends 2025, 45% błędnych priorytetów CX wynika właśnie z biasu, prowadząc do strat rzędu 1-5% revenue.

Celem artykułu nie jest zniechęcanie do badań ankietowych, ale pokazanie, jak świadomie projektować ankiety customer experience i interpretacji danych, żeby unikać błędów.

Poniższa sekcja zawiera 7 podsekcji, każda opisująca jeden typ błędu w kontekście badań CX i VoC. Błędy są pogrupowane tematycznie – od konstrukcji ankiety, przez próbę, zachowania respondentów, po analizę danych. Do każdego błędu wskazuję definicję, wpływ na wyniki, przykład oraz konkretne wskazówki ograniczenia ryzyka.

To jeden z najczęstszych błędów w badaniach ankietowych. Błąd sformułowania pytania sugeruje odpowiedzi poprzez sposób zadania pytania – respondent jest prowadzony do “właściwej” odpowiedzi zanim ją wybierze.

Typowe przykłady z ankiet CX:

Pytania sugerujące mogą prowadzić respondentów do udzielania odpowiedzi zgodnych z oczekiwaniami badacza, co zniekształca wyniki badań. Nacechowany język zawyża oceny o 18-25% w ankietach online CX. Pytania sugerujące mogą zmuszać respondentów do pozytywnego nastawienia, co zaniża liczbę negatywnych opinii.

Pytania podwójne łączą dwa wątki w jednym pytaniu, co uniemożliwia rzetelną ocenę. Jeśli pytasz “Czy obsługa była szybka i profesjonalna?”, nie wiesz, którą cechę klient ocenia.

Dobre praktyki:

Response bias to grupa zjawisk, w których klienci odpowiadają inaczej niż faktycznie myślą. Błędy w ankietach mogą prowadzić do zjawiska social desirability bias lub acquiescence bias, co sztucznie zawyża wyniki.

Najczęstsze typy:

Przykład: Ankieta wysłana zaraz po kontakcie z konsultantem – klient nie chce “donieść” na konkretną osobę, więc wybiera wyższe oceny obsługi. Konsekwencje? Systematyczne zawyżenie ocen jakości obsługi i trudność w wychwyceniu realnych problemów.

Sposoby ograniczania:

Błąd doboru próby występuje, gdy próba respondentów nie reprezentuje całej bazy klientów. W ankietach CX często docieramy tylko do osób korzystających z określonych kanałów, pomijając pozostałych.

Bias przetrwania (Survivorship Bias) to skłonność do skupiania się na danych od tych, którzy odnieśli sukces, ignorując dane od tych, którzy nie przetrwali, co prowadzi do błędnych wniosków – w praktyce oznacza to brak reprezentatywnej próby w badaniach marketingowych. W CX oznacza to badanie tylko klientów, którzy “przetrwali” proces – dokończyli zakup, dotrwali do końca rozmowy.

Przykład: Badanie NPS banku tylko wśród osób zalogowanych do bankowości internetowej w ostatnich 30 dniach pokazuje +45. Nieaktywni klienci, którzy odeszli do konkurencji, mają realny NPS -15 – ale ich głos nie jest słyszalny.

Praktyczne kroki:

Długie ankiety drastycznie obniżają jakość danych. Im dłuższa ankieta, tym większe ryzyko przerwania lub pobieżnego odpowiadania (satisficing). Każde pytanie powyżej piątego podnosi dropout o 25%.

Konsekwencje:

Błąd braku odpowiedzi powstaje, gdy duża część klientów ignoruje ankietę – a długość jest głównym powodem ignorowania i jednym z najczęstszych błędów w całym procesie badawczym.

Rekomendacje:

Konstrukcja ankiety i sama struktura skali może wprowadzać bias. Niewłaściwa skala odpowiedzi, brak opcji neutralnej lub stosowanie skal asymetrycznych wymusza pozytywną ocenę. Ograniczenie respondentów w precyzyjnym określeniu skali danego zjawiska prowadzi do zniekształcenia wyników.

Bias świeżości (Recency Bias) to skłonność do nadawania większej wagi najnowszym danym lub ostatnim opcjom na liście (+20% wyboru ostatnich odpowiedzi).

Skutki:

Dobre praktyki:

Patrzenie wyłącznie na zagregowaną średnią (“nasz NPS to +35”) bez analizowania rozkładu i segmentów klientów to rodzaj analitycznego biasu. Bias selekcyjny (Selection Bias) występuje, gdy próbka danych jest wybrana w sposób, który nie odzwierciedla całej populacji docelową, co prowadzi do błędnych wniosków.

Przykład: Średni NPS dla całej bazy = +35. Ale:

Uśrednienie maskuje problem pojawia się w onboardingu nowych klientów – najważniejszy segment dla wzrostu.

Praktyki:

Bias potwierdzenia (Confirmation Bias) to tendencja do zauważania i interpretowania informacji w sposób, który potwierdza istniejące przekonania, co może prowadzić do zniekształcenia rzeczywistości. W CX objawia się wyszukiwaniem danych potwierdzających z góry przyjęte hipotezy.

Przykład: Zespół oczekiwania wzrostu NPS po wdrożeniu nowego IVR. Koncentruje się na pozytywnych zmianach w segmencie młodych klientów (+8 p.p.), ignorując spadek u seniorów (-12 p.p.) i w kanale telefonicznym.

Confirmation bias może wpływać na cały proces: konstrukcję ankiety (pytania pod tezę), wybór wskaźników, dobór okresów porównawczych, sposób prezentacji na zarządzie.

Sposoby ograniczania:

Poniższa lista to praktyczna “ściągawka” dla CX managera do przejścia przed uruchomieniem każdego badania:

| Obszar | Pytanie kontrolne |

|---|---|

| Język pytań | Czy pytania są neutralne, bez przymiotników wartościujących? |

| Długość | Czy ankieta ma tylko niezbędną liczbę pytań (3-5)? |

| Skale | Czy skale są spójne, symetryczne i zgodne z poprzednimi badaniami? |

| Próba | Czy próba obejmuje kluczowe segmenty i punkty styku? |

| Pilotaż | Przeprowadzenie pilotażu ankiety z małą grupą pozwala zidentyfikować niedociągnięcia |

| Segmentacja | Czy zaplanowano segmentację i powiązanie z danymi transakcyjnymi? |

| Odpowiedzi otwarte | Czy przewidziano analizę tekstu (kategoryzacja, sentyment)? |

| Hipotezy | Czy zespół zdefiniował z góry pytania biznesowe? |

| Jasność | Jasność pytań ankietowych jest kluczowa – należy unikać skomplikowanego języka |

Brak testowania ankiety przed jej dystrybucją może prowadzić do problemów, takich jak zbyt skomplikowane pytania niezrozumiałe dla respondentów. Używanie skomplikowanego języka technicznego prowadzi do nieprecyzyjnych odpowiedzi klientów.

Mit “im więcej odpowiedzi, tym lepiej” jest szczególnie problematyczny w CX. Duża próba może być obciążona poważnym biasem – precyzyjnie mierzymy coś innego niż myślimy.

Bias związany z małymi próbkami (Small Sample Bias) występuje, gdy wnioski są wyciągane na podstawie zbyt małej liczby danych – w takich sytuacjach warto w ogóle rozważyć, kiedy nie przeprowadzać badań ankietowych lub zastąpić je innymi metodami. Ale odwrotność też nie gwarantuje wiarygodność wyników – 20 000 odpowiedzi wyłącznie od użytkowników aplikacji mobilnej może być mniej wartościowe niż 800 odpowiedzi z dobrze zbalansowanej próby obejmującej mobile, www i oddziały.

Jakość danych zależy od:

Niejasne pytania ankietowe mogą prowadzić do błędnych interpretacji i niskiej jakości danych, dlatego ważne jest, aby pytania były jasne i bezpośrednie. W dojrzałych programach VoC “liczba odpowiedzi” jest traktowana pomocniczo – w centrum są wskaźniki jakości danych.

Bias w ankietach CX jest nieunikniony, ale można nim zarządzać. Opisane 7 błędów to “lista kontrolna” do regularnego przeglądu – od tworzenia ankiet przez zbieranie danych po analizę. Sama wysoki poziom NPS i liczba odpowiedzi nie wystarczą bez analizy jakości danych.

Dojrzałe podejście łączy:

Pierwszy krok możesz zrobić od razu: wybierz jedno aktualnie realizowane badanie (np. NPS po kontakcie z infolinią) i sprawdź, które z opisanych błędów mogą w nim występować. To podstawa do świadomego prowadzenia badań, które ostatecznie dostarczą wiarygodne wyniki i rzetelne dane do podejmowanie strategicznych decyzji.

“Zwykły” błąd pomiaru ma charakter losowy (szum), podczas gdy bias jest systematyczny i przesuwa wyniki w konkretnym kierunku – na przykład zawsze zawyżone NPS. Błąd kolejności pytań wpływa na odpowiedzi w dalszej części ankiety – to przykład biasu, nie szumu. Bias wynika z powtarzalnych decyzji badawczych, a nie pojedynczych przypadkowych pomyłek respondentów. Wcześniejsze pytania mogą wpływać na to, jak respondent odpowiada na drugie pytanie i kolejne.

Nie – wysoki NPS może współistnieć z poważnym sampling biasem lub pytaniami sugerującymi. O jakości badania świadczą: sposób rekrutacji respondentów, stabilność wyników w czasie i między kanałami, treść odpowiedzi otwartych oraz powiązanie NPS z rzeczywistymi zachowaniami (churn, zakupy). Dopiero połączenie wysokiego NPS z dobrą metodologią pozwala traktować wskaźnik jako wiarygodne źródło do identyfikacji trendów.

Minimum raz w roku audyt kluczowych ankiet (NPS, CSAT, CES), a dodatkowo zawsze przy dużych zmianach w procesach klienta. Sygnałem do audytu są nietypowe zmiany wyników bez jasnej przyczyny lub nierówny udział segmentów w próbie. W audyt warto angażować nie tylko badaczy, ale też osoby z operacji znające realne procesy – pomoże to prowadzić do lepszych wyników i uniknąć fałszywych wniosków.

Tak – odpowiedzi otwarte często ujawniają rozbieżności między oceną liczbową a realnym doświadczeniem. Klienci wystawiają wysokie oceny, ale w komentarzach opisują problemy – to sygnał social desirability bias. Systematyczna analiza tekstu pozwala zweryfikować, czy metody NPS/CSAT nie dają zniekształconych danych i czy wiarygodność badania jest zachowana.

Praktyczne symptomy: selektywne pokazywanie tylko “ładnych” wyników, brak miejsca na wnioski sprzeczne z przyjętą tezą, unikanie tematów podważających skuteczność projektów. Wprowadzenie “devil’s advocate” w przeglądzie wyników i standardowego szablonu raportowania (z sekcjami na pozytywne i negatywne wnioski) pomaga ograniczyć ryzyko. Ograniczanie confirmation bias wymaga przyzwolenia zarządu na dyskusję o niewygodnych insightach – to zmiana kulturowa, nie tylko metodologiczna, ale niezbędne dla wiarygodności całego programu VoC.

Copyright © 2023. YourCX. All rights reserved — Design by Proformat